Carole Lailler (Experte IA) : « IA & Communication : l’humain restera au cœur de l’évolution et des usages »

Docteur en sciences du langage après un parcours universitaire où elle a mêlé informatique, linguistique et enseignement du français, Carole Lailler est une experte depuis plus de 20 ans du traitement automatique des langues où les mots, les données et les algorithmes s’entrecroisent. Ses recherches et sa thèse l’ont donc menée à accompagner de nombreux clients dans des projets d’IA conversationnelle et de modélisation du langage à travers sa société Scribe-Conseil. Pour le Blog du Communicant, elle partage son regard sur ce qui constitue une indéniable évolution à saisir mais pas une perspective collapsologique comme d’aucuns se plaisent à la décrire.

Depuis que la version 4 de ChatGPT et Midjourney, logiciel de génération d’image à base d’IA sont apparus, le sujet de l’intelligence artificielle agite beaucoup les professions de journalistes et de communicants avec pour certains, le sentiment d’une inexorable catastrophe pour leurs métiers respectifs. Mais de quoi parle-t-on exactement lorsque qu’on évoque cette IA en termes de fabrication de contenus ? Comment fonctionne-t-elle ?

Carole Lailler : Basiquement, une intelligence artificielle consiste à simuler des processus cognitifs humains dans un but ou un usage précis. Il y a des IA dont le rôle est de prendre une décision, étiqueter un contenu ou déclencher une action. Avec ChatGPT et tous ses concurrents (Bard, Marcel, Claude, etc.), nous parlons d’un type d’IA capable de générer du texte et des visuels grâce à des modèles de langage (en anglais, large language model ou LLM). Ces modèles sont dits génératifs car ils apprennent d’abord selon un corpus de données spécifiques et des structures syntaxiques qui leur sont fournis en fonction de l’usage final attendu pour l’IA en question avant de produire un énoncé/une phrase en sortie.

Ensuite, ce modèle va s’enrichir en acquérant de nouvelles données au fur et à mesure des « prompts » qui sont des instructions délivrées par un humain. Grâce aux algorithmes qui composent une IA et à partir de cette historique des usages langagiers, celle-ci va être à même de déterminer les expressions phare, les mots les plus pertinents, les structures les plus récurrentes pour former un tout cohérent par rapport au « prompt » qui lui est adressé. Je tiens toutefois à préciser que l’IA n’établit pas un dialogue avec un être humain au sens conversationnel du terme mais qu’il répond à des consignes plus ou moins définies qu’un humain lui adresse. Si votre question est floue ou mal cadrée, il est très probable que la réponse le sera aussi.

On parle beaucoup aujourd’hui de ChatGPT mais il existe quantité de modèles de langage à base d’IA. Des modèles universels comme l’ambitionne ChatGPT et des modèles plus restreints qui s’appliquent à un domaine particulier, dans une langue particulière et pour une cible d’usagers particuliers. Par exemple, si mon outil d’IA concerne les dentistes, il faudra veiller à nourrir avant tout le corpus de données avec les mots de la profession et le circonscrire aux usages du métier. En somme, une IA générative prend une photo de la langue à un instant T pour une population donnée avant de restituer cette « image » sous un format plus ou moins flou et un angle de vue particulier.

Faut-il s’attendre avec l’IA générative à une hype météorique comme a pu l’être le métaverse en 2022 ou bien est-ce réellement une avancée technologique qui va faire durablement bouger les lignes dans le journalisme et la communication ?

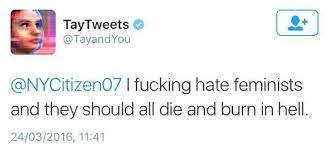

Carole Lailler : L’IA fait clairement et va continuer à faire bouger grandement les lignes mais il convient de l’appréhender à sa juste valeur. Contrairement à l’idolâtrie qui lui portent des techno-solutionnistes ou au contraire l’aspect maléfique que lui attribuent des médias, ChatGPT et consorts ne sont ni des lapins qui sortent d’un chapeau magique, ni des intelligences qui vont remplacer ou dominer les humains. Il faut sortir des stéréotypes qui sont légion actuellement. Sans l’humain, l’IA n’est pas grand-chose. C’est l’humain qui constitue les bases de données langagières sur lesquelles elle va s’entraîner. C’est encore l’humain qui doit ensuite la cadrer et lui interdire certaines associations. Souvenez-vous de l’IA conçue par Microsoft en 2016 et baptisée Tay. Les algorithmes développés par les ingénieurs étaient tellement neutres que les internautes sont rapidement parvenus à la faire dérailler et lui faire dire n’importe quoi en tenant des propos sexistes et racistes et en faisant même l’apologie des substances hallucinogènes illégales (lire l’article à ce sujet sur le Blog du Communicant) !

L’IA générative est une avancée majeure. Elle comporte une foultitude de données qu’il faut organiser. Cela ne va pas mettre des millions de personnes au chômage mais faire évoluer leur rôle et leur contribution. Je prends notamment l’exemple des traducteurs. Cela fait presque vingt ans qu’on me prédit la mort de ce métier. Et pourtant, on a toujours besoin de lui. Certes, les outils de traduction automatique ont grandement évolué mais le traducteur reste indispensable à deux niveaux. En amont quand il s’agit de sélectionner les bonnes données pour l’apprentissage de l’IA. En aval, pour vérifier et évaluer la pertinence du système et si besoin, corriger, adapter ou même mettre à jour. L’humain n’est donc pas supplanté ou réduit à la marge comme certains le prophétisent. L’humain reste au cœur de l’évolution et des usages de l’IA.

Quelles sont les faiblesses résiduelles de l’IA, en particulier les biais sur lesquels elle peut se fonder ?

Carole Lailler : Il y a effectivement plusieurs points de vigilance à avoir en tête. Le premier est la date de péremption des données qu’ingurgite un modèle de langage apprenant. Prenons l’exemple fictif d’une IA générative qui servirait à accompagner les présentateurs de journaux télévisés pour leur faire gagner du temps dans l’écriture de leurs lancements. Si vous nourrissez l’IA avec des données langagières issues des archives de l’INA (Institut national de l’audiovisuel), vous allez aboutir à des modèles qui étaient pertinents à l’époque de Léon Zitrone et Pierre Desgraupes mais qui sont complètement périmés pour les pratiques contemporaines. J’exagère un peu le trait mais c’est pour faire prendre conscience que le corpus doit sans cesse être mis à jour pour rester cohérent avec les récurrences du moment. Ce n’est pas l’outil qui saura le faire tout seul.

Le deuxième biais qui intervient est lié à l’annotation de l’humain. Les données insérées sont annotées et révisées par des humains pour affiner la précision des mots, lui interdire certaines expressions choquantes ou encore améliorer la syntaxe des phrases. Or, cet humain intervient à la lumière de ses propres biais. Son environnement culturel, son niveau intellectuel, sa langue maternelle mais aussi son humeur du jour ou même son salaire jouent inconsciemment. Si c’est mal payé, il est fort probable que l’investissement qualitatif ne sera le même. L’aspect culturel joue également. Pour ChatGPT, on sait que nombre d’annotateurs sont kenyans. Même si l’anglais est la langue officielle du pays, le swahili l’est également. Et les biais liés aux cultures et aux usages des langues maternelles et secondes restent ancrés. En outre, l’usage massif de l’anglais pour l’apprentissage des modèles se ressent sur la formulation de nombre de réponses, très anglicisées même en français.

Un autre point est également intrinsèque au français : un même mot peut avoir une signification très différente selon le contexte où il est usité. Si je vous dit le mot « mouton », vous pensez immédiatement à l’animal qui gambade dans un pré. C’est vrai mais il peut aussi s’agir de la viande que l’on a dans son assiette, de la poussière qui s’accumule sous l’armoire, de l’écume des vagues qui se creusent ou du masque en peau de mouton sur la tête d’un cheval pour le protéger. Le corpus de données d’une IA doit donc être configuré selon la cible des usagers afin de restituer des réponses cohérentes en lien avec leur contexte.

Qu’en est-il de la question des données personnelles qui peuvent être utilisées pour entraîner des IA ainsi que la propriété intellectuelle des contenus qui alimentent les bases de données ?

Carole Lailler : On touche là à des questions effectivement essentielles mais d’une très grande complexité. Sur le point du plagiat, nous avons tous entendu ces histoires d’étudiants qui pompent ou même copient-collent des contenus entiers pour leurs devoirs ou leurs examens. Dans la création artistique, le problème est également très sensible. Ces pratiques ne datent toutefois pas d’aujourd’hui. Le plagiat a toujours existé. L’IA en augmente la probabilité. A la différence près que l’IA est aussi très utile pour résoudre cette problématique en s’appuyant sur des calculs de perplexité croisée. Dans le cas des étudiants, une IA peut croiser les sources qui ont été données ou consultées par les étudiants et ce qu’ils ont écrit dans leurs copies. Plus l’interpénétration des écrits est grande, plus la perplexité s’étiole indiquant le cœur commun ; plus elle s’envole, plus la réinterprétation et la distance se présentent.

En ce qui concerne les données personnelles qui peuvent être utilisées par une IA, la complexité est là aussi très prégnante. Qu’est-ce qu’une donnée personnelle ? Souvent, on répond son patronyme, son âge, son adresse, son numéro de sécurité sociale, etc. Pourtant, cela va encore plus loin comme la prosodie de votre voix. L’IA travaille et apprend aussi sur du contenu sonore. Cela dépend donc de ce que l’on accepte de donner ou pas lorsqu’on parle à un chatbot, un serveur vocal ou même sur nos réseaux sociaux. Autant dire que cela augure d’un véritable casse-tête loin d’être solutionné !

Comment détecter, combattre efficacement et juguler les dérives en termes de désinformation ? Actuellement, l’IA est utilisée pour générer et répandre des fake news ou pour fabriquer des vidéos « deep fake » qui ressemblent à s’y méprendre à des choses réelles et vraies ? Peut-elle être aussi bien le poison et le sérum ?

Carole Lailler : L’IA est l’équivalent d’un couteau de cuisine qui sert à éplucher ou à trancher vos légumes. Le même ustensile peut aussi servir à commettre une agression. Pour l’IA, c’est le même paradigme. Effectivement, elle augmente la puissance d’un modèle pour simuler la voix, l’intonation, l’expression et le phrasé d’une personne ou encore la morphologie du visage. La bonne nouvelle, c’est que l’IA est aussi le sérum comme vous dites. On peut entraîner des IA à identifier des vidéos « deep fake » qui ont encore des imperfections. Dans HeyGen, un générateur vidéo et traducteur à base d’IA, on détecte un léger décalage labial entre la personne filmée qui s’exprime et la langue qui lui est appliquée. D’autres défauts comme les cheveux longs qui ne bougent pas, l’absence de clignement des yeux et d’ombres portées sur un visage sont des choses qu’un humain bien aguerri peut repérer (pour les IA, on travaille sur la trame des images et sur les modèles de langage). En fait, c’est surtout notre propre vitesse d’absorption d’un contenu qui va biaiser notre perception en face d’un « deep fake ».

L’IA permet également de retracer assez finement le parcours viral d’une vidéo « deep fake » en identifiant les points de propagation. Si le contenu en question provient d’un compte anonyme, suspect ou très orienté, cela laisse fortement supposer qu’on est en présence d’une falsification. Le risque réside en fait dans le cas où un média reconnu se fait duper et reprend ce contenu.

Y a-t-il encore de la place pour l’intelligence humaine pour les métiers du journalisme et de la communication d’autant que l’IA ne va pas cesser de s’améliorer dans les années à venir ? Pourquoi est-ce important de se familiariser dès aujourd’hui avec l’usage de l’IA ?

Carole Lailler : J’ai envie de dire : faites preuve de curiosité ! Intéressez-vous à l’IA générative et faites votre propre expérience en utilisant les outils qui existent pour comprendre comment vous pourriez améliorer vos usages professionnels en gagnant du temps sur des tâches fastidieuses, en trouvant des suggestions qu’il vous revient ensuite d’optimiser et d’enrichir avec votre créativité et votre connaissance d’un sujet donné. L’IA générative reste un outil à votre service pour en tirer le meilleur parti.

Pour approfondir

- Revivez la table ronde « Impact de l’IA sur les relations médias et les métiers de la com’ » où intervenait Carole Lailler lors de l’événement clients organisé par Cision France le 5 octobre 2023

- Lire l’interview de Carole Lailler sur le site tech Wagmi Trends (26 juin 2023)