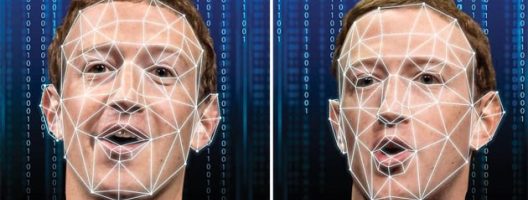

[IA générative & désinformation] : Sommes-nous condamnés à subir et vivre dans un monde de fausseté ?

Les outils à base d’IA générative ont accompli des bonds prodigieux ces derniers mois en matière de création d’images, de vidéos et de voix. Nombre d’entre eux sont malheureusement utilisés à des desseins de désinformation et de manipulation de l’opinion publique ou alors de fraudes massives qui peuvent entacher la réputation d’une entreprise. Au-delà du risque patent de déstabilisation des démocraties et des médias qui informent sérieusement, existe-t-il pour autant des solutions pour endiguer ces assauts qui polluent le débat public et brouillent la réalité des faits ?

Le 5 février dernier, les autorités policières de Hong-Kong ont révélé une arnaque au président d’un genre nouveau. Grâce à la production de deepfakes ultraréalistes, des escrocs sont parvenus à abuser un employé d’une multinationale du pays et lui soutirer ainsi 24 millions d’euros à travers plusieurs virements. Le malheureux collaborateur avait été invité à participer à une visioconférence qui regroupait plusieurs de ses collègues dont le directeur financier qui n’étaient en fait que des avatars vidéo redoutablement similaires aux vrais personnages. Le faux financier a alors ordonné des transferts d’argent vers différents comptes détenus par les pirates et l’affaire était dans le sac. A ce jour, l’enquête est toujours en cours pour reconstituer les étapes de cet incroyable fric-frac à base d’intelligence artificielle.

Quand l’IA générative sert à désinformer pour détrousser

Depuis que Midjourney, Dall-E et consorts ont mis à disposition leurs toutes dernières versions de leurs logiciels, les trucages ont pris une autre ampleur et coloration. C’est ainsi qu’en mars dernier, la sonnette d’alarme a été tirée en France à propos d’une escroquerie du même acabit que celle de Hong-Kong. Plusieurs deepfakes ont circulé sur Facebook, Instagram et Twitter/X avec des vidéos mettant en scène des journalistes français très connus (comme Elise Lucet ou encore Laurent Delahousse) où ces derniers dévoilent une méthode jusque-là gardée secrète par la Banque de France (sic) pour gagner beaucoup d’argent sans trop d’efforts. Pour accroître le sentiment de véracité, certaines vidéos renvoyaient sur des sites d’information comme Le Monde, eux aussi parfaitement imités puis des sites incitant à contacter un conseiller pour investir dans des cryptomonnaies.

Les médias et têtes d’affiche concernés ont été prompts à réagir pour dénoncer officiellement l’usage frauduleux qui était fait de leur notoriété. En dépit des mises en garde, plusieurs personnes sont tombées dans le panneau comme cette quinquagénaire citée par le quotidien régional La Dépêche. Piégée par la « caution » affichée avec Elise Lucet, cette femme a misé et perdu plusieurs dizaines de milliers d’euros. Le cas n’est pas isolé. Avocat spécialisé dans les contentieux, Me Jocelyn Ziegler déclare avoir reçu 600 dossiers de plainte depuis 2023, avec un préjudice moyen approchant les 120 000 euros. Le record appartenant à une cheffe d’entreprise qui s’est fait délester de 6 millions d’euros (1).

Quand l’IA générative sert à désinformer pour influencer

Cette désinformation malveillante où l’IA générative sert à accentuer le caractère réaliste du contenu diffusé, n’a pas que des visées de grivèlerie. D’aucuns (et parfois les mêmes) utilisent les deepfakes pour opérer des campagnes de déstabilisation informationnelle et accentuer le doute et la défiance dans les démocraties occidentales. L’actuelle guerre en Ukraine est un terrain de jeu privilégié par les Russes pour effectuer des raids de désinformation en s’appuyant sur les boucles Telegram et WhatsApp, aspirateurs et épandeurs de deepfakes en tous genres comme l’envoi imminent en Ukraine, de bataillons de soldats français. Deepfakes que s’empressent ensuite de confirmer publiquement les pontes du régime de Vladimir Poutine pour accroître la portée médiatique de l’infox.

La propagande russe s’autorise tous les excès pour déstabiliser l’univers informationnel européen et français en particulier. Tout récemment, c’est BFMTV qui a été victime d’une deepfake comme le relate le magazine Le Point. A partir du 12 avril, une fausse vidéo qui reprend à la perfection l’habillage graphique de la chaîne, commence à tourner en boucle notamment dans les réseaux complotistes et pro-russes francophones. Le reportage affirme que quatre journalistes du Nord de la France sont suspectés par la DGSI (Direction générale de la Sécurité intérieure) d’avoir révélé des cas de punaises de lit à l’hôpital d’Arras et que depuis, ils ont été suspendus par leurs rédactions respectives. L’objectif ? Accréditer l’idée que la censure gouvernementale opère à fond.

L’histoire est pourtant falsifiée. Si les journalistes ont bien évoqué le cas d’un homme hospitalisé (que l’établissement a isolé le temps de tout désinfecter), ils n’ont pas été inquiétés ni par la DGSI, ni par leur hiérarchie. Directeur de l’ONG DisinfoLab EU, Alexandre Alaphilippe décrypte les ressorts de la méthode (2) : « Il s’agit de semer le doute sur la crédibilité des médias traditionnels et d’amener leurs lecteurs à doute, y compris de leur vrai contenu. En parallèle, il s’agit de faire monter des sources d’information dites alternatives qui vont-elles aussi, accroître le chaos dans l’espace informationnel ».

L’opinion publique française dans le doute

Il n’en demeure pas moins que l’heure est grave. La défiance déjà l’œuvre depuis plusieurs années, gagne du terrain à mesure que l’artillerie des deepfakes pilonne les réseaux sociaux à coups de fausses vidéos, fausses interviews et fausses répliques de sites d’information. En mars 2024, Ipsos et Sopra Steria ont publié une étude sur les Français et leur perception de la désinformation. Les résultats sont particulièrement préoccupants. 74 % des personnes interrogées estiment être « souvent confrontées à des informations délibérément fausses ». Par ailleurs, 77 % des sondés pensent que la diffusion de fausses informations impacte fortement le fonctionnement de la démocratie et 72 % craignent que la désinformation sur les réseaux sociaux influence le vote aux élections européennes du 9 juin (3).

Paradoxe de l’étude : si le panel déclare être inquiet, il se juge en revanche apte à débusquer les informations fausses. 74 % des sondés s’estiment en capacité de faire le tri entre les « vraies et les fausses ». Sauf que voilà ! Sur une série de 9 fausses informations qui leur ont été soumises, 66% adhéraient au moins à une proposition.

Une autre étude réalisée en avril par Adobe sur l’impact de l’IA dans la désinformation à l’aube du scrutin européen, souligne bien les enjeux. En France, 73% du panel sollicité juge qu’il est difficile de contrôler la véracité du contenu numérique (vidéos, images). 67 % craignent que de fausses informations et autres deepfakes ne perturbent les prochaines élections. Pour se prémunir des effets néfastes de la désinformation, 85 % pensent qu’il est important de disposer d’outils pour vérifier la véracité d’un contenu. Or, 51% de l’échantillon de l’étude estime qu’il est aujourd’hui impossible d’authentifier un contenu généré par l’IA. Une impasse qui a incité 37 % des Français à arrêter (ou réduire) leur utilisation de certains réseaux sociaux en raison du volume de fausses informations rencontrées (4).

La bataille est-elle perdue d’avance ?

Face à ce tableau sombre, la tentation de se replier sur soi et ne plus écouter les informations peut être tentante tant il est complexe de dissocier ce qui relève de la réalité et ce qui provient de la désinformation distillée par les milieux conspirationnistes et des Etats comme la Russie mais aussi la Chine. Le problème est que se mettre dans une coquille étanche ne résoudra pas le problème. Au contraire, cela laisse le champ libre aux propagateurs de fausses informations. Il existe pourtant des outils et des méthodologies pour disposer d’une premier filtre sélectif et éviter de se faire absorber par l’infox pour souvent ensuite la redistribuer à sa communauté.

Cette petite prophylaxie informationnelle est adaptable par n’importe qui. Pas besoin d’être un as de la recherche inversée sur Google ou d’avoir des logiciels spécialisés pour détecter un faux contenu. En tout premier lieu, il convient de s’informer auprès de plusieurs sources fiables afin d’avoir une vision large sur un sujet donné. Ensuite, à chaque information reçue, il est nécessaire de s’interroger sur la source à l’origine du contenu. Qu’on le veuille ou non, la qualité informationnelle d’un article paru dans Le Monde, Le Figaro, Les Echos, etc est nettement plus crédible qu’un site dit alternatif qui se targue de révéler de soi-disant informations occultées ou tronquées par les pouvoirs politiques et économiques. Un parangon de cette posture fallacieuse est le site torchon France Soir qui sous couvert d’un vernis scientifique, débite à tort et à travers des énormités sur les vaccins ou encore le dérèglement climatique. Tout en hurlant constamment à la censure !

Lire les publications de fact-checking

En plus du paysage médiatique français qui est suffisamment riche en titres, il y a d’autres sources d’information utiles à connaître et à consulter sur le sujet plus spécifique de la désinformation. Les sites de fact-checking et de debunking de plusieurs médias français accomplissent un remarquable travail de détection et de démontage des fausses nouvelles. Ils proposent même des newsletters gratuites (et des boucles WhatsApp) auxquelles on peut s’abonner pour être informé des dernières manipulations et infoxs en date. Pour mémoire, on peut recommander les excellents sites d’AFP Factuel, CheckNews de Libération, Les Décodeurs du Monde, Fake Off de 20 minutes, les Vérificateurs de TF1 ou encore Vrai ou Fake de France Info.

Autre canal possible pour celles et ceux qui voudraient approfondir les mécanismes de la désinformation : les publications de Viginum, une cellule gouvernementale de veille et de protection contre les ingérences numériques étrangères, qui est rattachée au secrétariat général de la Défense et de la Sécurité nationale. Cet organisme publie régulièrement des rapports très fouillés et instructifs sur l’état de la menace informationnelle que chacun peut télécharger. Il existe enfin des acteurs spécialisés qui scrutent et décortiquent également en permanence les actions de désinformation. Sans être exhaustif, il faut signaler les publications de Conspiracy Watch, EU DisinfoLab et NewsGuard. Ce trio produit de très pertinentes analyses à propos de ceux concourent à la désinformation actuelle.

Quelles parades technologiques ?

Dans le combat contre la désinformation, il ne faut néanmoins pas perdre de vue une autre dimension : celle de la technologie et de son accessibilité accrue à n’importe quel quidam. Aujourd’hui, une personne sans compétence particulière en informatique peut aisément fabriquer un deepfake à travers les dizaines de générateurs de fausses vidéos qui sont actuellement disponibles sur Internet. Autant Photoshop requérait certaines compétences pointues pour parvenir à un résultat acceptable, autant des outils comme Midjourney, Dall-E (pour les images), HeyGen, Sora (pour la vidéo et la voix) génèrent des contenus particulièrement troublants de réalisme si le prompt initial est bien exécuté. Conséquence : cela abaisse les barrières technologiques et contribue à des diffusions à plus grande échelle de la désinformation.

Pour être efficace, il convient d’être en mesure de déployer des technologies au moins aussi sophistiquées (voire plus) que celles usitées par ceux qui les propagent. Cela supposerait notamment que les éditeurs de générateurs de deepfakes laissent un accès et un contrôle de leurs bases de données où leurs IA s’entraînent. Le hashmatching peut par exemple constituer un outil de lutte efficace pour enrayer à la propagation virale des contenus frelatés. Concrètement, il s’agit d’une technologie qui repère des marqueurs numériques dans une vidéo (hachage) puis qui grâce à un algorithme, les confronte à une base de données de contenus faux répertoriés pour établir des correspondances (matching). En novembre 2023 au Royaume-Uni, le régulateur Ofcom a notamment édicté des règles pour que les plateformes publiques (non chiffrées) utilisent cette technologie pour repérer ces contenus à risque.

Autre piste existante : le watermarking. A l’instar du filigrane inséré dans les billets de banque pour attester de leur authenticité, ce marquage numérique invisible permettrait d’identifier l’outil qui a servi à la fabrication d’un contenu (ou même la base de données sur laquelle l’IA générative apprend), voire retracer le chemin vers celui qui l’a réalisé avant sa diffusion grâce à une empreinte chiffrée qui est associée à l’émetteur. Néanmoins, cette traçabilité, pour utile qu’elle soit, ne résout pas tout et peut aussi se heurter à des contraintes réglementaires et juridiques selon les pays.

Nommer les choses pour faire reculer la désinformation

Si le risque de désinformation est devenu de toute évidence très prégnant, il est absolument essentiel de ne pas baisser les bras. Certes, aucun dispositif ne sera jamais totalement infaillible d’autant que l’intelligence artificielle évolue à une vitesse supersonique qui nécessite une adaptation constante des outils de détection et de traçage. Néanmoins, en couplant une culture de la vigilance au niveau individuel dans notre consommation d’informations et des réponses technologiques pour juguler les dérives, il est possible de faire refluer et abaisser l’impact des deepfakes et autres joyeusetés charriés par la désinformation.

A cela, s’ajoute également une stratégie de communication qui consiste en quelque sorte à faire du « name and shame » lorsqu’une opération de désinformation affecte la réputation d’une organisation ou d’un pays. C’est notamment la stratégie qu’a récemment empruntée l’Etat français à l’égard des assauts informationnels falsifiés lancés par la Russie qui n’a cessé ces derniers temps d’intensifier ses actions. Chercheur associé à l’Institut de recherche stratégique de l’École militaire (Irsem), Maxime Audinet commente (5) : « c’est, en fait, surtout la France qui change de posture. Elle attribue les attaques informationnelles et communique beaucoup, en étant à la fois plus défensive et plus offensive ». Autrement dit, les porte-paroles du gouvernement attribuent désormais ouvertement à la Russie, un rôle de commanditaire et d’acteur. N’est-ce pas l’écrivain et journaliste, Albert Camus, qui écrivait en 1944 : « Mal nommer les choses, c’est ajouter au malheur de ce monde » ? Cela reste plus que jamais d’une grande acuité ! Une raison supplémentaire pour dire ouvertement qui se livre à du tripatouillage informationnel, preuves à l’appui.

Sources

- (1) – « Victime d’une fausse publicité utilisant l’image d’Elise Lucet pour vanter des placements financiers, une femme a perdu 90 000 € » – La Dépêche – 9 février 2024

- (2) – Nicolas Quénel – « BFMTV est ciblée à son tour par une opération de désinformation russe » – Le Point – 20 avril 2024

- (3) – Peggy Baron – « Une étude dresse le portrait d’une France vulnérable aux fake news » – L’ADN – 13 mars 2024

- (4) – Philippe Rioux – « Élections : pourquoi 7 Français sur 10 craignent la désinformation » – La Dépêche – 21 avril 2024

- (5) – Justine Brabant et Matthieu Suc – « Les dessous de la bataille française contre la désinformation russe » – Mediapart – 20 avril 2024