Algorithmes & Désinformation : A quel jeu dangereux se livre actuellement Meta (ex-Facebook) ?

Les révélations n’ont guère fait de bruit médiatique, y compris aux Etats-Unis où Meta est scrupuleusement observé à la loupe. Pourtant, les changements algorithmiques qui s’annoncent sur Facebook et Instagram ainsi que la probable disparition de CrowdTangle, un outil de veille pour les contenus postés sur ces deux plateformes (ainsi que Reddit) acquis par Meta, ne constituent pas une bonne nouvelle pour lutter contre la désinformation et son extrême viralité. A quoi joue exactement Mark Zuckerberg ?

Au cours d’un entretien accordé à la chaîne américaine à propos de ses ambitions dans le domaine du métaverse, Mark Zuckerberg a profité de l’occasion pour glisser que les algorithmes de contenus sur Facebook et Instagram allaient évoluer de la manière suivante (1) : « Nous passons d’un système où la plupart des contenus que vous voyez sur Facebook et Instagram sont issus de vos amis ou des gens que vous suivez à un modèle où de plus en plus de contenus sont le fruit des recommandations de l’intelligence artificielle. A mesure que les recommandations de l’IA s’améliorent, vous avez accès, vous savez, non seulement au contenu des personnes que vous suivez, mais aussi à tout l’univers de contenu existant ».

TikTok en ligne de mire

Concrètement, cette modification algorithmique (déjà opérationnelle sur Instagram depuis le 15 mai dernier et envisagée prochainement sur Facebook) consiste à ne plus mettre en avant des publications issues de comptes et de profils qu’un utilisateur suit mais à donner la priorité à des contenus correspondant aux centres d’intérêt de ce même utilisateur, peu importe la source émettrice sur Facebook et Instagram. Ce changement de paradigme assez radical est censé être la réplique de Meta face à l’insolente progression de TikTok, notamment parmi les plus jeunes générations.

Bien que TikTok n’ait jamais ouvertement communiqué sur les critères de fonctionnement de son algorithme de suggestion de contenus, nombreux sont les experts qui s’accordent à dire que le temps passé sur une vidéo est un des éléments prépondérants pour pousser via une intelligence artificielle, de nouveaux contenus afférents aux utilisateurs selon leur langue, leur géolocalisation et leurs thèmes de prédilection. Avec un objectif précis : retenir le plus longtemps possible l’individu sur la plateforme chinoise et justifier ainsi d’une audience qui se paie ensuite en monnaie sonnante et trébuchante auprès des annonceurs.

L’enjeu est donc énorme. D’autant plus que la société d’analyse de données mobiles App Annie (devenue Data.ai depuis février 2022) relève que les utilisateurs français passaient deux fois plus de temps en moyenne sur TikTok que sur Instagram en 2020. Aux États-Unis, le ratio entre les deux concurrents a même triplé (2). Pour Meta, le risque est donc grand de voir les marques dépenser leurs budgets chez le rival plutôt que sur ses plateformes.

Et la désinformation, on en parle ?

Seulement voilà ! Derrière la problématique financière et marketing de ce chamboule-tout algorithmique, réside un enjeu supplémentaire autrement plus préoccupant que la santé du portefeuille de Meta : l’accroissement de la désinformation et de sa viralité auprès du grand public. En s’inspirant de l’approche de TikTok, la probabilité de voir les mêmes dérives informationnelles s’enkyster est plus qu’élevée. La plateforme chinoise est en effet régulièrement pointée du doigt pour son absence de modération et pour sa capacité à propulser des fake news tant la durée de visionnage d’un contenu prime largement sur la qualité et la fiabilité du dit contenu.

L’exemple le plus emblématique de cette distorsion informationnelle est celui de l’actuel conflit ukrainien où la guerre des images sévit intensément sur TikTok. En mars dernier, six analystes de la société NewsGuard, spécialisée dans la lutte contre la propagation des fausses informations et l’évaluation de la fiabilité de l’information en ligne, ont opéré une édifiante étude. Pendant une semaine (du 11 au 16 mars), ils se sont immergés dans les contenus publiés en anglais, français, allemand et italien où il est question de la guerre en Ukraine.

Rédactrice en chef et vice-présidente Europe et Canada de Newsguard, Chine Labbé livre le résultat de ces observations (3) : « Nous cherchions à savoir ce qui se passe sur TikTok pour un utilisateur lambda qui s’intéresse un tant soit peu au sujet de l’Ukraine et ce que proposait l’algorithme sur ce sujet […] Certaines (NDLR : vidéos) étaient fausses, mensongères, d’autres sans contexte ou avertissement, certaines provenant de médias de confiance mais avec des contenus pouvant choquer. Toutes les vidéos, qu’il s’agisse d’informations fiables ou de propagande du Kremlin, sont mises sur le même plan. Il est difficile pour l’utilisateur de hiérarchiser ». Le tout sans que TikTok ne soit particulièrement proactif pour enrayer le problème.

Les bulles informationnelles vont s’amplifier

Directeur des opérations et fondateur du cabinet de veille digitale Saper Vedere et fin connaisseur des mécaniques virales sur les réseaux sociaux, Nicolas Vanderbiest est un des rares experts à avoir tiré la sonnette d’alarme récemment dans un thread sur Twitter. A ses yeux, nul doute que si Meta duplique le mode de fonctionnement de suggestion de contenus en vigueur sur TikTok, c’est la porte ouverte à des excès informationnels en tout genre (4) : « L’homogénéisation des contenus va être intense ne laissant de place qu’au contenu qualifié par un ensemble de critères. De fait, cela va aussi favoriser les contenus clivants, ludiques et avec une faible qualité informationnelle. Le fait de qualifier des contenus et non plus des gens fait perdre toute autorité à des créateurs de contenu. Un media ou des personnes à forte audience seront mis au même niveau que le premier lambda. Porte ouvertes à la désinformation ».

C’est d’autant plus une mauvaise nouvelle pour la qualité de l’information que les bulles informationnelles étaient déjà à l’œuvre depuis quelques années. Nous avons encore tous en mémoire comment l’algorithme de Facebook a permis par exemple en France de faire se coaguler des colères multiples contre le gouvernement Macron pour contribuer à la naissance des Gilets Jaunes. C’est la même mécanique qui a propulsé les complotistes, antivax et antipass dans la rue après avoir largement percolé sur Facebook (et d’autres réseaux sociaux). Pour Nicolas Vanderbiest, le remède face à cette désinformation potentielle, peut résider dans (5) « les décideurs […] qui forcent Facebook à ouvrir une API permettant d’obtenir une vue globale de ce qui circule sur la plateforme et ce qui y est favorisé ».

CrowdTangle au rebut ?

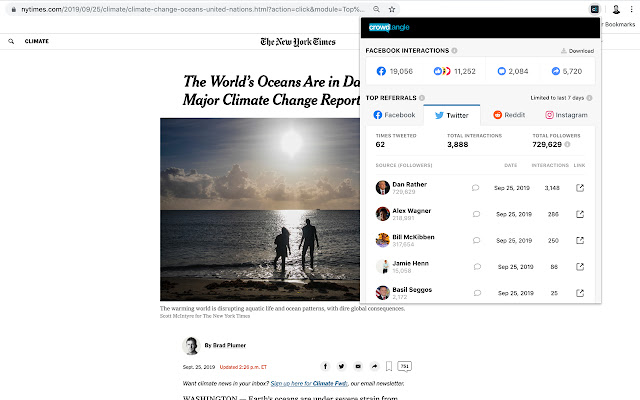

A peine Mark Zuckerberg avait-il confirmé ses intentions algorithmiques (que le site spécialisé américain The Verge avait déjà bien éventées quelque temps plus tôt) qu’une deuxième menace semble poindre sur l’horizon de la désinformation. Toujours selon The Verge (mais également Bloomberg), CrowdTangle, l’outil de veille et de tracking des contenus circulant sur Facebook, Instagram et Reddit, serait sur la sellette. Ce dernier est une application d’analyse publique acquise par Meta en 2016 qui aide les éditeurs, les journalistes, les chercheurs, les vérificateurs de faits, etc, à analyser ce qui se passe sur les médias sociaux et à mieux comprendre le cheminement et les flux qu’empruntent les contenus.

L’outil a enregistré un vrai engouement chez les chercheurs et dans la presse. Journaliste en charge de l’émission Tech & co sur BFMTV et rédacteur en chef adjoint de BFM Business, Raphaël Grably fait partie de ses adeptes convaincus comme il l’a rappelé dans un thread récent sur Twitter (6) : « C’est grâce à CrowdTangle que j’avais pu sortir plusieurs articles. Notamment sur la domination de l’extrême-droite sur Facebook pendant la présidentielle. Mais aussi comment une vidéo complotiste publiée par le « gourou » antisémite Jean-Jacques Crèvecœur arrivait en tête des publications sur le vaccin sur Facebook ».

Si la mise au rebut de CrowdTangle s’avérait officiellement validée par Meta, il s’agirait pour Raphaël Grably de la destruction du « seul outil de transparence qu’il proposait » (7). Par l’accès unique que CrowdTangle procure aux sujets d’actualité, aux comptes publics et aux communautés, ainsi qu’aux publications virales sur Facebook, Instagram et Reddit, sa disparition rendrait en effet ces données inaccessibles et les observateurs totalement aveugles sur les mécaniques de désinformation qui sont à l’oeuvre.

Avis de vigilance accrue

Ce ne serait pas la première fois que Facebook ferme brusquement un outil de recherche essentiel. En juin 2019, il a soudainement supprimé Graph Search, qui permettait aux chercheurs et aux militants de localiser et de vérifier des séquences de témoins oculaires sur la plateforme et de documenter les violations des droits de l’homme. Pour l’instant, rien de définitif n’a filtré chez Meta. Cependant, les signaux faibles laissent transpirer une issue malheureuse. Bloomberg révèle notamment que plusieurs personnes en charge du support technique de CrowdTangle ont été affectées sur d’autres missions ou ont quitté l’entreprise.

Erin McPike, une porte-parole de Meta, a certes déclaré que l’entreprise continuerait à soutenir les chercheurs et prévoyait de mettre à leur disposition des outils encore plus précieux tout en répétant que Meta maintiendrait CrowdTangle en vie au moins jusqu’aux élections de mi-mandat américaines de 2022 (le 8 novembre). Oui mais après ? Facebook n’a jamais été un parangon de vertu dans la lutte contre la désinformation. Même si ce dernier doit par ailleurs s’astreindre au respect du Digital Services Act que l’Union européenne a décrété depuis avril 2022, la vigilance va devoir être accrue à l’égard des intentions de Meta. Faute de quoi, certains remakes de désinformation caractérisée pourraient survenir à nouveau. Mais ça, Meta s’en moque peut-être ouvertement du moment que l’argent des annonceurs rentre ?

Sources

– (1) – Jordan Novet – « Mark Zuckerberg envisions a billion people in the metaverse spending hundreds of dollars each » – CNBC – 22 juin 2022

– (2) – Benjamin Hue – « Facebook et Instagram changent de modèle : pourquoi vous allez moins voir les posts de vos amis » – RTL.fr – 23 juin 2022

– (3) – Pauline Croquet – « Guerre en Ukraine : TikTok expose et recommande de fausses informations sur la guerre en Ukraine à ses utilisateurs » – Le Monde – 23 mars 2022

– (4) – Thread Twitter de Nicolas Vanderbiest – 23 juin 2022

– (5) – Ibid.

– (6) – Thread Twitter de Raphaël Grably – 24 juin 2022

– (7) – Ibid.