Fake news, IA & Information : la cote d’alerte est-elle en train d’être franchie ?

Se dirige-t-on tout droit vers un univers informationnel où le vrai du faux sera devenu indissociable et indétectable ? L’idée de cette inquiétante perspective est pourtant loin d’être une lubie. Le faux contenu généré par de l’intelligence artificielle (IA) atteint désormais de tels niveaux de sophistication que l’oeil humain mais aussi les logiciels ont de plus en plus de mal à discerner ce qui est authentique de ce qui est apocryphe. Fractl, une agence britannique expert en contenus digitaux, vient d’en fournir la démonstration à travers un vrai-faux blog entièrement conçu par IA. Objectif ? Alerter sur les potentielles dérives éditoriales qui peuvent abuser les lecteurs mais aussi les robots d’indexation des moteurs de recherche.

À peine avait-on commencé à se familiariser avec la “deep fake video” qui repoussait déjà fortement les frontières de la falsification informationnelle, qu’une autre technologie est en train de soulever d’immenses questions sur les risques de désinformation et de spamming massifs. À l’origine, il s’agit d’un projet de recherche mené par un laboratoire de recherche américain AI2 (Allen Institute for Artificial Intelligence). Créé en 2014 par Paul Allen, l’un des co-fondateurs de Microsoft, cet organisme explore et analyse les possibles usages de l’intelligence artificielle dans divers secteurs. Pour contrer les fake news propagées par des réseaux de neurones artificiels, AI2 a élaboré un puissant outil de détection baptisé Grover.

L’effet Grover

Afin d’être en capacité maximale de repérer les contenus fake générés par IA, y compris les plus sophistiqués, Grover intègre notamment une fonctionnalité spécifique qui lui permet de fabriquer lui-même ce type de contenus afin d’en apprendre automatiquement les caractéristiques et ainsi les reconnaître.. Avec un niveau de performance plutôt élevé puisque Grover parvient à atteindre un taux de 92% de détection de fake news là où les autres outils existants se situent en moyenne à 73% (1). Mais, les chercheurs sont également tombés sur un autre constat de taille durant l’expérimentation anti-fake news effectuée avec Glover.

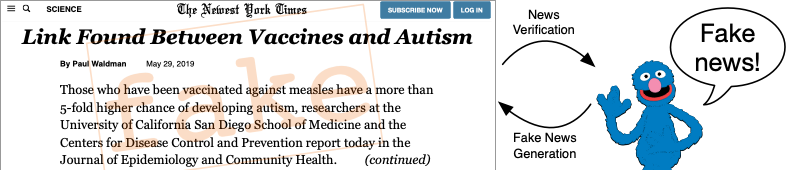

Il avait en effet été demandé à l’outil de produire un article scientifique bidon sur les liens de causalité entre les vaccins et l’autisme. Grover s’est tellement bien acquitté de sa tâche qu’il a réussi à induire en erreur les participants de l’étude qui ont lu le dit article et l’ont trouvé plus crédible que les sources réelles d’information qui leur avaient été soumises en parallèle ! Qu’il s’agisse de la cohérence rédactionnelle, de la pertinence du contenu and la confiance globale inspirée, l’article a été jugé plus fiable que les autres contenus pourtant valides. En conclusion du test, le professeur Yejin Choi de l’université de Washington à déclaré (2) : “Notre travail avec Grover démontre que les meilleurs modèles pour détecter la désinformation sont aussi les meilleurs modèles pour la produire. Le fait que les participants à notre étude aient trouvé que les fausses histoires créées par Grover inspiraient plus confiance que celles écrites par des humains, illustre la profonde évolution technologique pour générer du langage naturel. Et aussi la nécessité de reprendre de l’avance sur cette menace”.

Plus vrai que nature

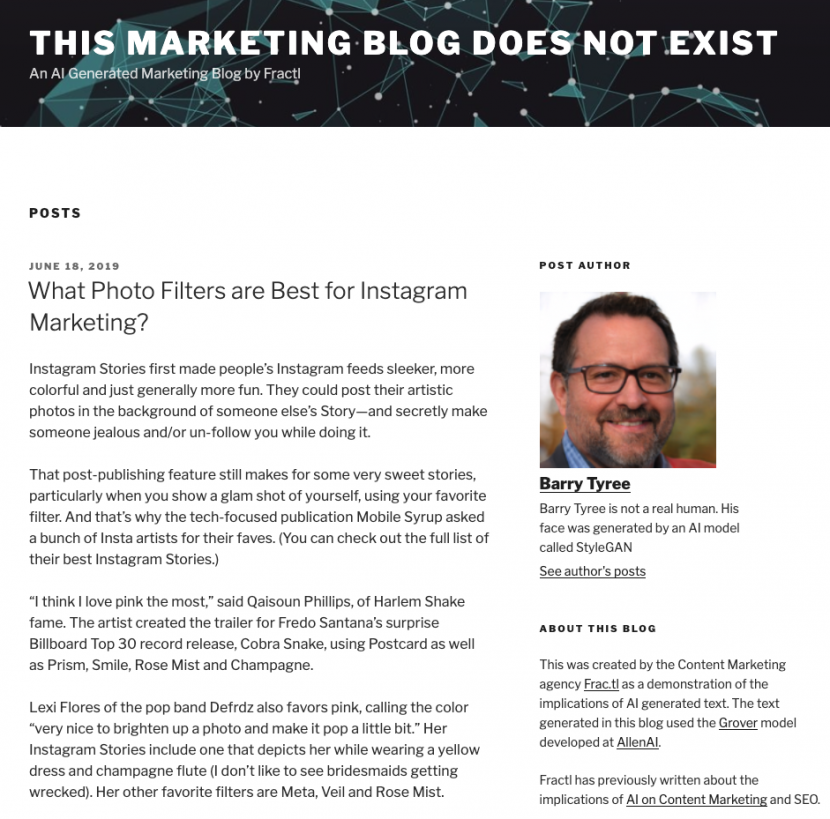

Intriguée par cette découverte presque paradoxale, l’agence britannique Fractl a décidé de réaliser à son tour une expérience identique en s’appuyant également sur Grover. Pour cela, elle a construit un vrai-faux blog intitulé malicieusement “This marketing blog does not exist” avec un sous-titre non moins plaisantin : “An AI Generated Marketing Blog by Fractl” ! Le résultat final est proprement bluffant. Le blog ressemble à s’y méprendre aux codes visuels et éditoriaux empruntés par les influenceurs marketing qui animent des blogs. Hormis les titres, tous les contenus sont le fruit de l’IA de Grover et atteignent un niveau d’expression et de style écrit carrément surprenant. De l’expression familière à la tournure de phrase en vogue et à l’usage du jargon du métier, les billets mis en ligne sont stupéfiants de crédibilité. Ceci d’autant plus qu’ils sont accompagnés de la photo (fake elle aussi) de l’auteur qui fait plus vraie que nature.

Au-delà de l’aspect apocryphe de ces contenus qui font facilement tomber dans le panneau, la co-fondatrice de l’agence qui a initié ce projet de faux blog, déplore l’existence d’une autre menace bien réelle. Du fait de l’extrême plausibilité des contenus publiés par IA, ceux-ci collent en tout point aux critères de référencement que Google impose. L’effet collatéral n’est donc pas neutre puisqu’il risque là aussi de fausser la pertinence des contenus affichés par Google lors d’une requête d’utilisateur. Kristin Tynski explique (3) : “À mon avis, Google et les autres moteurs de recherche (et plus globalement Internet) entrent dans une nouvelle ère de risque. Il semblerait que ce soit le début d’une nouvelle course à l’armement entre Google et les spammeurs”.

Venin et antidote en même temps ?

Dans ce contexte, prend-on le chemin d’un paysage informationnel où la fausse nouvelle sera indémêlable de la vraie ? Les tromperies à visée propagandiste et manipulatoires ont certes toujours existé mais jusqu’à présent, elles finissaient toujours par être éventées. Aujourd’hui, la sophistication technologique aidant avec l’intelligence artificielle, les lignes du vrai et du faux se brouillent à un point jamais atteint dans l’histoire de l’humanité. Pour AI2 qui a mis au point Grover à la fois venin et antidote, il ne convient pas pour autant de s’affoler (4) : “Notre étude présente un résultat surprenant : la meilleure façon de détecter des infoxs à base d’IA consiste à utiliser un modèle qui est aussi un générateur. Le générateur est plus familier avec les habitudes, les traits et les bizarreries de langage. Notre modèle, Grover, est un générateur qui peut facilement repérer ses propres articles faux aussi bien que ceux générés par d’autres IA”.

Pour autant, il n’est pas si sûr que la seule solution ne soit que technologique. L’éducation à l’esprit critique et la capacité à prendre du recul vont devenir des impératifs absolus si le lecteur/spectateur ne veut pas être aspiré dans un maelstrom de fake news que plus rien ne dissocie de la réalité avérée. Et encore ! Nombre d’études scientifiques ont montré que les biais cognitifs humains, le poids de la croyance et le besoin de renforcer celle-ci nous conduisent nous-même dans des impasses informationnelles. À l’heure actuelle, nombreux sont celles et ceux qui croient mordicus que les astronautes américains n’ont jamais foulé la Lune en 1969. Et de s’employer à démontrer et à ratiociner par tous les moyens que l’exploit lunaire n’est qu’un pur produit de propagande. De même, pour ceux qui s’échinent à penser que la Terre est plate malgré l’évidence des preuves et des millions de clichés pris depuis l’espace ! En attendant, si vous voulez tester par vous même la capacité de Grover à produire du fake qui a le goût du vrai, vous pouvez toujours consulter cette démo d’AI2. Disponible en anglais uniquement pour l’instant ! Il y a encore quelques limites !

Sources

- (1) – Kimberley Mok – “Grover AI Detects Machine-Generated ‘Neural’ Fake News — By Also Generating It” – The New Stack – 20 juin 2019

- (2) – Ibid.

- (3) – Patrick Kulp – “New AI Can Detect Fake News With Unprecedented Accuracy—and Generate Its Own” – AdWeek – 31 mai 2019

- (4) – Tristan Greene – “This terrifying AI generates fake articles from any news site” – The Next Web – 24 juin 2019

Un commentaire sur “Fake news, IA & Information : la cote d’alerte est-elle en train d’être franchie ?”-

L’IA dont vous parlez n’est pas de l’IA en dépit de la pub des GAFAM complaisamment relayée par les médias sans contrôle. C’est de l’informatique classique avec des informaticiens derrière. Elle exprime la volonté hégémonique de quelques grands groupes américains et non celle des milliards d’utilisateurs de la planète, les seuls vrais destinataires d’une véritable IA. Si elle existait vraiment, depuis le temps qu’on en parle comme une réussite (1980…), elle serait entrée dans nos foyers et il n’y aurait plus d’informaticiens. Il se trouve que cette IA existe depuis la fin des années 1980… et en France ! C’est l’intelligence artificielle raisonnante. Elle a même reçu un prix américain en 2017, le « Awards Ai ». La seule récompense jamais reçue par des Français dans ce domaine. Les informaticiens, les chercheurs IA, les GAFAM n’en ont pas parlé… On se demande pourquoi.

Pendant ce temps-là, le public attend, ignorant que l’IA est à sa portée depuis 30 ans, submergé des mensonges éhontés d’une catégorie de travailleurs bien déterminée à conserver son monopole et à continuer à paralyser le progrès…