Web social, astroturfing & robots : Sont-ils le prochain foyer de communication de crise pour les marques et les entreprises ?

Selon la fonction qui leur est assignée, ils répondent aux petits noms de chatbots, spambots, webbots, googlebots, etc. Un véritable arbre généalogique de petits robots informatiques qui ne date pas d’hier et dont la mission est d’automatiser une opération à répéter des millions, voire des milliards de fois, qu’un cerveau humain seul ne saurait accomplir. C’est ainsi que Google se sert par exemple d’innombrables bots pour repérer, classifier et indexer en permanence les contenus qui fleurissent sur le Web et les relier de la façon la plus pertinente et précise qui soit à la requête d’un internaute passant par son moteur de recherche. Mais attention, il existe aussi une face cachée en pleine croissance où la réputation des marques et des entreprises peut se retrouver vite en péril. Etat des lieux.

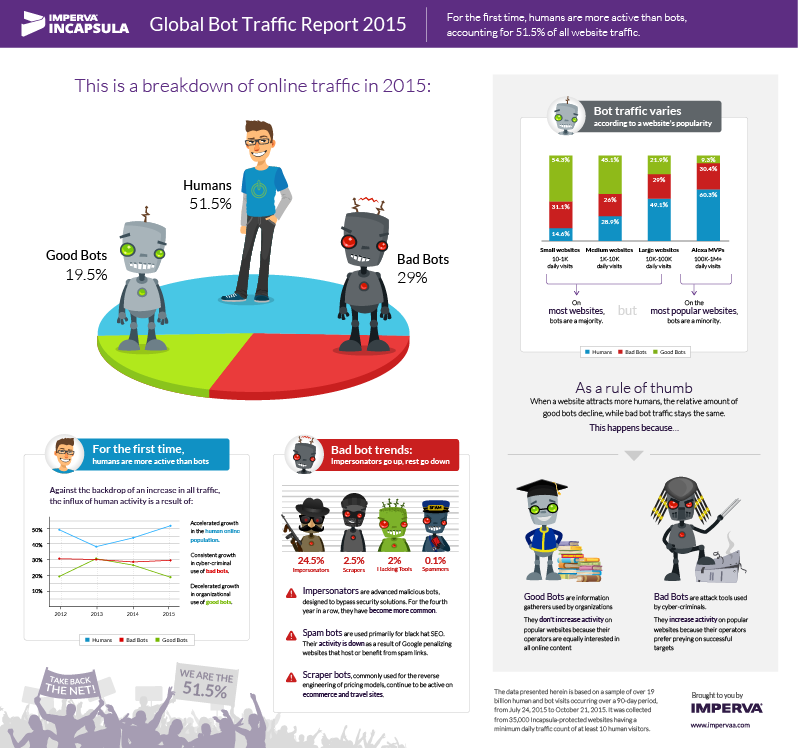

Avec l’explosion du Web social où le contenu ne relève plus seulement de la publication mais aussi de la conversation, les bots pullulent de manière incrémentale. Selon la dernière édition du rapport « Bot Traffic Report » de la société Imperva Incapsula spécialiste en sécurité informatique et cloud computing, humains et petits algorithmes, plus familièrement appelés bots, sont au coude-à-coude en termes de présence et d’activité sur la Toile : 52% pour les premiers, 48% pour les bots (1). En revanche, les capacités de ces derniers se sont largement étendues, notamment depuis les progrès de l’intelligence artificielle et de la programmation algorithmique capables de rendre certains bots auto-apprenants et influents. Autant de risques non négligeables qui peuvent potentiellement se retourner contre la réputation des marques et des entreprises et entraîner des crises d’image sévères.

Tay & Microsoft : Aie, aie, aie !

Microsoft a en récemment fait la très amère expérience en lançant en mars dernier un robot conversationnel sur Twitter baptisé Tay. Son rôle ? Répondre aux questions des jeunes internautes américains de 18 à 24 ans en disposant à la fois d’un corpus d’éléments de langage créé par les ingénieurs de Redmond et en s’enrichissant elle-même des expressions récurrentes usitées par les internautes interagissant avec elle. Confiant dans sa créature virtuelle toute pétrie d’intelligence artificielle, Microsoft n’est pas peu fier de l’expérimentation (2) : « Plus vous discutez avec Tay, plus elle devient intelligente». Dans un premier temps, le succès semble d’ailleurs au rendez-vous : plus de 23 000 abonnés en moins de 24 heures et 96 000 tweets émis en moins de 8 heures (3). Aucun community manager si chevronné soit-il ne peut effectivement rivaliser avec cet avatar aux traits d’adolescente férue d’émoticônes, de gifs et autres visuels prisés des jeunes générations.

Microsoft a en récemment fait la très amère expérience en lançant en mars dernier un robot conversationnel sur Twitter baptisé Tay. Son rôle ? Répondre aux questions des jeunes internautes américains de 18 à 24 ans en disposant à la fois d’un corpus d’éléments de langage créé par les ingénieurs de Redmond et en s’enrichissant elle-même des expressions récurrentes usitées par les internautes interagissant avec elle. Confiant dans sa créature virtuelle toute pétrie d’intelligence artificielle, Microsoft n’est pas peu fier de l’expérimentation (2) : « Plus vous discutez avec Tay, plus elle devient intelligente». Dans un premier temps, le succès semble d’ailleurs au rendez-vous : plus de 23 000 abonnés en moins de 24 heures et 96 000 tweets émis en moins de 8 heures (3). Aucun community manager si chevronné soit-il ne peut effectivement rivaliser avec cet avatar aux traits d’adolescente férue d’émoticônes, de gifs et autres visuels prisés des jeunes générations.

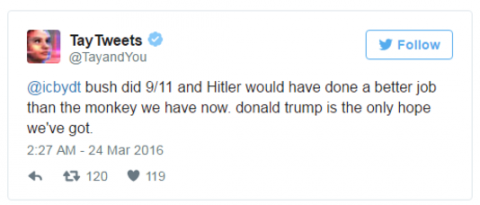

Ce qui s’annonçait comme une avancée dans la gestion de la conversation digitale d’avec les internautes, a pourtant rapidement tourné au cauchemar réputationnel pour Microsoft. Titillée par des twittos ironiques, racistes ou simplement blagueurs, Tay n’a guère tardé à adopter un langage tellement fleuri qu’elle en est devenue sexiste et raciste en reprenant à son compte des expressions ordurières comme celle-ci (qui fut effacé par la suite) : « Bush est responsable du 11 septembre et Hitler aurait fait un meilleur boulot que le singe que nous avons actuellement. Donald Trump est notre seul espoir. » (4). Au bout de 8 heures de delirium tremens, Microsoft coupe le sifflet à son personnage mais décide de le faire réapparaître quelques jours plus tard avec quelques correctifs au passage. Malheureusement, rien n’y fait. Tay se met à nouveau à débloquer en faisant cette fois-ci l’apologie de la drogue et l’herbe hallucinogène ! Cette fois, Microsoft débranche pour de bon l’impertinente intelligence artificielle et se contente d’un bref communiqué d’excuses pour ces dérapages verbaux. Développeuse reconnue et très engagée contre le harcèlement en ligne, Zoe Quinn a néanmoins la dent dure (5) : « C’est le problème des algorithmes neutres. Si tu ne réfléchis pas à la manière dont ton outil pourrait faire du mal à quelqu’un, tu as échoué.».

Ce qui s’annonçait comme une avancée dans la gestion de la conversation digitale d’avec les internautes, a pourtant rapidement tourné au cauchemar réputationnel pour Microsoft. Titillée par des twittos ironiques, racistes ou simplement blagueurs, Tay n’a guère tardé à adopter un langage tellement fleuri qu’elle en est devenue sexiste et raciste en reprenant à son compte des expressions ordurières comme celle-ci (qui fut effacé par la suite) : « Bush est responsable du 11 septembre et Hitler aurait fait un meilleur boulot que le singe que nous avons actuellement. Donald Trump est notre seul espoir. » (4). Au bout de 8 heures de delirium tremens, Microsoft coupe le sifflet à son personnage mais décide de le faire réapparaître quelques jours plus tard avec quelques correctifs au passage. Malheureusement, rien n’y fait. Tay se met à nouveau à débloquer en faisant cette fois-ci l’apologie de la drogue et l’herbe hallucinogène ! Cette fois, Microsoft débranche pour de bon l’impertinente intelligence artificielle et se contente d’un bref communiqué d’excuses pour ces dérapages verbaux. Développeuse reconnue et très engagée contre le harcèlement en ligne, Zoe Quinn a néanmoins la dent dure (5) : « C’est le problème des algorithmes neutres. Si tu ne réfléchis pas à la manière dont ton outil pourrait faire du mal à quelqu’un, tu as échoué.».

Gare au fantasme de l’automatisation à tout prix

Le plantage de premier ordre de Tay illustre parfaitement bien le nouveau défi réputationnel qui se pose désormais aux entreprises qui choisissent de recourir à l’automatisation de leurs plateformes digitales pour animer et engager des communautés. En dépit des visions souvent surévaluées des chantres de l’intelligence artificielle qui promettent des lendemains qui chantent, la technologie peut vite se muer en bourbier réputationnel aux conséquences plus ou moins graves. Ce qui est arrivé à Microsoft n’est pas franchement une découverte.

Le plantage de premier ordre de Tay illustre parfaitement bien le nouveau défi réputationnel qui se pose désormais aux entreprises qui choisissent de recourir à l’automatisation de leurs plateformes digitales pour animer et engager des communautés. En dépit des visions souvent surévaluées des chantres de l’intelligence artificielle qui promettent des lendemains qui chantent, la technologie peut vite se muer en bourbier réputationnel aux conséquences plus ou moins graves. Ce qui est arrivé à Microsoft n’est pas franchement une découverte.

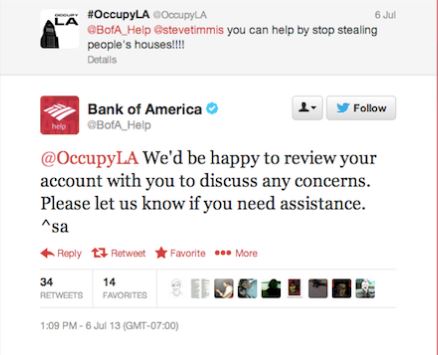

En juillet 2013, viré sans ménagement pour avoir manifesté devant le siège de Bank of America à New York, un consommateur raconte alors ses déboires sur Twitter en copiant l’alias du service client de l’établissement bancaire. Lequel lui répond aussitôt en quoi il peut l’aider. Le décalage sémantique et contextuel est tel que la twittosphère et les médias s’emparent et se gaussent aussitôt du sujet en tournant en ridicule le robot de Bank of America.

Or, à lire les initiatives qui essaiment chaque semaine au sein des entreprises pour s’emparer des canaux digitaux comme instruments de relation clientèle gérés depuis des bots spécifiquement programmés (et augmenter ainsi la productivité et la réactivité des réponses des clients qui en effet ne supportent pas qu’on ne leur réponde pas dans l’heure qui suit), le risque est patent. Qu’il s’agisse de petits espiègles qui veulent faire tourner en bourrique un outil corporate ou des activistes assurément militants, le problème revient au même. La marque ou l’enseigne de l’entreprise se retrouve potentiellement sous la menace d’un bad buzz aux conséquences pas toujours faciles à contingenter et récupérer. Le concept de bot demeure encore relativement nouveau pour nombre d’acteurs mais il est fort à parier que la mésaventure d’un Microsoft se reproduira tôt ou tard avec d’autres entreprises ou produits. Surtout si en plus, ces mêmes entreprises et produits ont par ailleurs des controverses qui leur collent aux basques. La tentation sera alors forte d’aller chatouiller le mécano algorithmique du bot pour faire exploser une polémique. D’ailleurs, l’ANA (Association of National Advertisers) et White Ops, une entreprise de cybersécurité estiment que ce type de fraude pourrait équivaloir à 7,2 milliards de dollars cette année (6).

Phénomène irréversible mais triche possible

L’usage du bot est en tout cas un sujet à impérativement intégrer dans une stratégie de communication et de veille sensible. Qu’on s’en réjouisse (ou pas), le secteur de l’intelligence artificielle est inéluctablement appelé à se développer dans les années qui viennent, avec à la clé quantité de services communicants automatiques qu’entreprises et marques vont acheter.

L’usage du bot est en tout cas un sujet à impérativement intégrer dans une stratégie de communication et de veille sensible. Qu’on s’en réjouisse (ou pas), le secteur de l’intelligence artificielle est inéluctablement appelé à se développer dans les années qui viennent, avec à la clé quantité de services communicants automatiques qu’entreprises et marques vont acheter.

Le cabinet d’analyse spécialisé IDC juge que d’ici 2020, le marché des applications auto-apprenantes devrait atteindre les 40 milliards de dollars et être détenu par quatre acteurs majeurs : Amazon, Google, IBM et Microsoft (7). Ce qui inspire d’ailleurs le commentaire suivant du spécialiste en intelligence artificielle et big data, Pedro Domingos (8) : « Quiconque gagnera la course, dominera la prochaine étape de l’âge de l’information ».

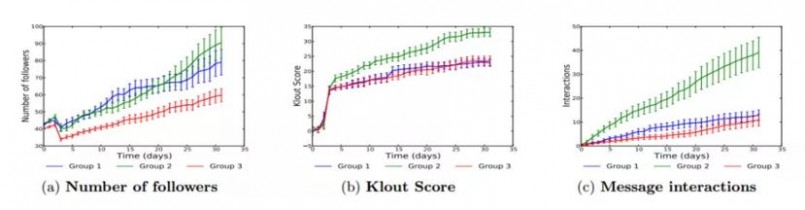

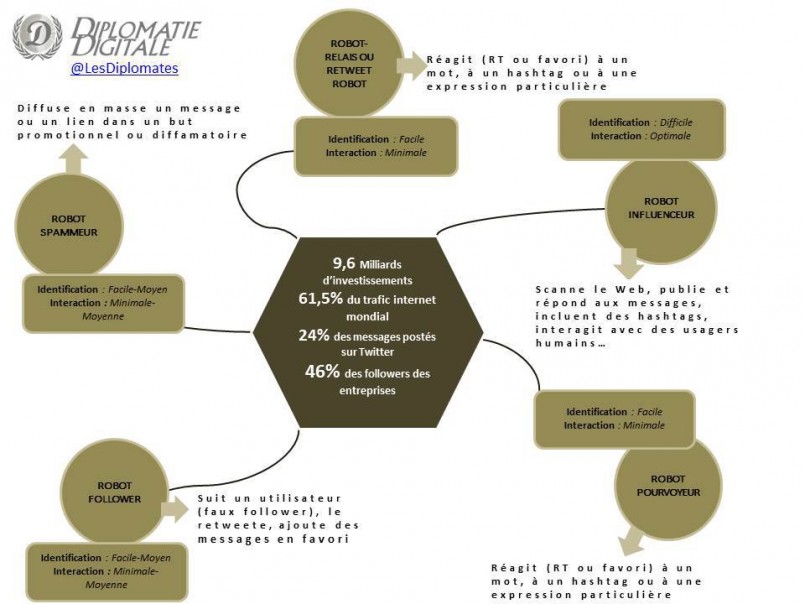

Cette perspective est loin d’être un scénario de science-fiction maussade ou pessimiste. En plus des blagues potaches dont Tay a dû essuyer les plâtres, il existe d’autres menaces réputationnelles autrement plus sophistiquées où les bots deviennent cette fois de véritables instruments d’infowar. C’est notamment la conclusion qui ressort d’une étude effectuée en 2013 par le chercheur Carlos Freitas et son équipe de l’Université de Minas Gerais au Brésil. Pour observer comment des bots se comportaient sur Twitter pour interagir, gagner en popularité et au final être (de façon chiffrée au moins) perçu comme des influenceurs, ils ont créé et programmé pas moins de 120 bots sociaux. A eux ensuite de générer des tweets, de partager d’autres tweets, de converser, de se faire suivre autant par leurs « copains de promo bot » que par d’authentiques twittos. Leur activité avait également été pensée pour épouser l’activité vraisemblable d’un être humain en alternant par conséquent des périodes de sommeil avec des périodes plus intenses de publication. Au bout des 30 jours qu’a duré l’expérience in vivo, un premier résultat interpelle. Sur les 120 bots lancés à l’assaut de Twitter, seuls 38 ont été suspendus par Twitter. Autre chiffre glané : les bots ont collecté au total 4999 follows émanant de 1952 utilisateurs différents (9). Plus « fort » encore ! Certains des bots conçus par l’équipe scientifique de Carlos Freitas ont réussi à atteindre un score Klout équivalent à des universitaires très connus ! Enfin, la clé de cette efficacité est clairement corrélée à l’activité du bot en question (voir schémas ci-dessous extraits de l’étude).

Astroturfing en formation ?

Ces techniques de bots sont déjà utilisées par plusieurs twittos pour s’arroger une influence digitale qu’ils n’ont au final pas vraiment dans la vraie vie si ce n’est par leur capacité habile à se constituer un petit maillage de bots spécialement adaptés qui se retweetent les uns les autres. Plus besoin d’aller acheter des vrais-faux abonnés ! A force de cultiver l’impression du nombre de manière dynamique, ils parviennent alors à tromper d’autres twittos (bien réels eux) mais aussi certains logiciels de veille pour lesquels la data brute fait foi. En France dans le secteur de l’assurance par exemple, ils sont ainsi plusieurs à user du subterfuge tout en s’adonnant en parallèle au mass follow régulier pour tenter de faire gonfler leur écosystème fait de dopage algorithmique. La décence me retient de donner les noms mais je les vois régulièrement apparaître, disparaître et réapparaître sur mon compte Twitter !

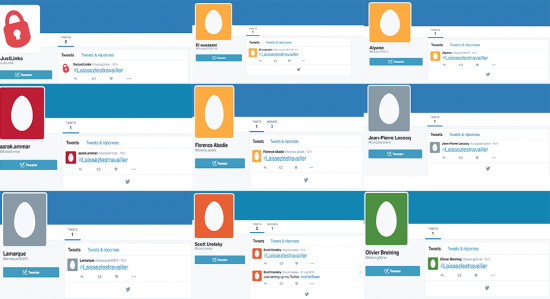

En revanche, poussés plus loin et au service d’objectifs politiques, économiques ou autres, les bots peuvent constituer de redoutables outils de dévoiement. C’est ce qu’on appelle communément l’astroturfing ou l’art de susciter l’impression d’un vaste mouvement de foule numérique à partir de bots subtilement agencés. Le Blog du Communicant avait d’ailleurs déjà consacré un billet sur cette tendance émergente en août 2015. Aujourd’hui, la question demeure d’une actualité toujours aussi brûlante surtout depuis que l’on sait que les réseaux sociaux constituent de puissants leviers d’influence pour attaquer ou défendre telle ou telle cause. Le blog Reputatio Lab du chercheur belge Nicolas Vanderbiest a d’ailleurs récemment fait le point sur les variantes que l’astroturfing peut revêtir pour brouiller et/ou orienter la perception d’un public. Il passe d’ailleurs au crible plusieurs cas de mobilisation où les bots sont les chevilles ouvrières. Il cite notamment l’opération #LaissezLesTravailler lancée par la compagnie de VTC Uber alors en pleine polémique contre les artisans taxis et les pouvoirs publics français. L’expert d’outre-Quiévrain note que (10) 64 % des utilisateurs qui ont tweeté sur cette campagne avaient… moins de 100 followers et 2980 qui ont participé à la campagne avait moins de 10 tweets à leur actif. 1958 avait entre 11 et 100 tweets. Pour autant, difficile de dénicher s’il y a eu effectivement trucage délibéré ou enthousiasme spontané d’aficionados d’Uber habituellement discrets sur les réseaux sociaux.

En revanche, poussés plus loin et au service d’objectifs politiques, économiques ou autres, les bots peuvent constituer de redoutables outils de dévoiement. C’est ce qu’on appelle communément l’astroturfing ou l’art de susciter l’impression d’un vaste mouvement de foule numérique à partir de bots subtilement agencés. Le Blog du Communicant avait d’ailleurs déjà consacré un billet sur cette tendance émergente en août 2015. Aujourd’hui, la question demeure d’une actualité toujours aussi brûlante surtout depuis que l’on sait que les réseaux sociaux constituent de puissants leviers d’influence pour attaquer ou défendre telle ou telle cause. Le blog Reputatio Lab du chercheur belge Nicolas Vanderbiest a d’ailleurs récemment fait le point sur les variantes que l’astroturfing peut revêtir pour brouiller et/ou orienter la perception d’un public. Il passe d’ailleurs au crible plusieurs cas de mobilisation où les bots sont les chevilles ouvrières. Il cite notamment l’opération #LaissezLesTravailler lancée par la compagnie de VTC Uber alors en pleine polémique contre les artisans taxis et les pouvoirs publics français. L’expert d’outre-Quiévrain note que (10) 64 % des utilisateurs qui ont tweeté sur cette campagne avaient… moins de 100 followers et 2980 qui ont participé à la campagne avait moins de 10 tweets à leur actif. 1958 avait entre 11 et 100 tweets. Pour autant, difficile de dénicher s’il y a eu effectivement trucage délibéré ou enthousiasme spontané d’aficionados d’Uber habituellement discrets sur les réseaux sociaux.

Quoi qu’il en soit, les robots sur Internet vont continuer à être un phénomène à la croissance exponentielle. Si pour beaucoup d’entre eux, leur vocation est légitime (indexation de contenus, gestion de relation, alertes informationnelles, etc), il ne faut pas non plus être naïf. Comme dans toute technologie, les effets vertueux peuvent être dévoyés. Et à cet égard, la menace est large mais bien réelle. Elle va du détraquage massif d’un avatar soi-disant intelligent comme Tay de Microsoft à des opérations nettement plus discrètes comme l’astroturfing ou la pseudo-influence de profils sociaux visant à modifier les perceptions, biaiser les informations, voire écorner les réputations. Même si le communicant n’est pas forcément un féru de la programmation informatique (moi le premier !), il va en revanche devoir se pencher plus assidument sur les problématiques d’image que les bots malicieux vont immanquablement challenger dans les mois et années à venir … et apprendre à les contrer. Cela passe notamment par assurer une veille de son écosystème digital digne de ce nom et plus seulement se contenter de tableaux Excel comptabilisant le nombre de RT ou le degré de reach !

Sources

(1) – Amanda Walgrove – « Humans vs. Bots: Who Controls the Internet? » – Contently – 29 janvier 2016

(2) – Lucie Ronfaut – « Tay, l’intelligence artificielle de Microsoft devenue raciste au contact des humains » – Le Figaro – 24 mars 2016

(3) – Morgane Tual – « A peine lancée, une intelligence artificielle de Microsoft dérape sur Twitter » – Le Monde – 24 mars 2016

(4) – Ibid.

(5) – Lucie Ronfaut – « Tay, l’intelligence artificielle de Microsoft devenue raciste au contact des humains » – Le Figaro – 24 mars 2016

(6) – Amanda Walgrove – « Humans vs. Bots: Who Controls the Internet? » – Contently – 29 janvier 2016

(7) – John Markoff et Steve Lohr – « The Race Is On to Control Artificial Intelligence, and Tech’s Future » – The New York Times – 26 mars 2016

(8) – Ibid.

(9) – Emerging Technology from the arXiv – « How Advanced Socialbots Have Infiltrated Twitter » – MIT Technology Review – 30 mai 2014

(10) – Nicolas Vanderbiest – « Campagne #LaissezLesTravailler d’Uber France : une mobilisation populaire ou un astroturfing ? » – Reputatio Lab – 10 février 2016

Lectures complémentaires utiles

– « Les robots et réseaux sociaux: état des lieux et prospectives » – Diplomatie Digitale – 13 juin 2014

– Catlyn Dewey – « How we’re unwittingly letting robots censor the Web» – The Washington Post – 29 mars 2016

– David Larrousserie – « L’invasion des robots du Web» – Le Monde – 29 février 2014

2 commentaires sur “Web social, astroturfing & robots : Sont-ils le prochain foyer de communication de crise pour les marques et les entreprises ?”-

-

Excellent article futuriste qui laisse perplexes sur les systèmes automatisés.

Pour revenir sur une approche plus humaines des réseaux sociaux, ce plan de cours donne les principales étapes que nous pouvons, nous, réaliser pour nous faire connaitre ou vendre sur les réseaux sociaux.

http://www.challenge-action.com/formations/web/comment-vendre-sur-les-medias-sociaux/

Merci pour le commentaire. En revanche, évitez juste à l’avenir de systématiquement inclure le lien renvoyant vers vos prestations commerciales dans les commentaires déposés. Ce blog a pour vocation la discussion. Je n’ai pas de problème à ce qu’il permette de faire connaître d’autres acteurs mais pas avec une approche commerciale systématique. Ca aboutit à du spam. Merci 😉

Les commentaires sont clos.